AIエージェントの安全性向上:AgentTrustの革新技術

AIエージェントの安全性向上を実現するAgentTrustの革新技術について詳しく解説。従来のインフラレベル防御を超えた実行前判断システムで、95%以上の判断精度と低遅延を実...

AIエージェントの安全性は、自律的なツール操作による予期しない損害を防ぐ上で最重要課題となっている。AgentTrustは実行前の安全性判断により95%以上の精度でリスクを検出し、AIシステムの信頼性を飛躍的に向上させる革新的な技術だ。この技術により、企業はAIエージェントを安心してビジネスに統合できる環境が整いつつある。

AIエージェントの安全性とは

AIエージェントの安全性とは、システムが自律的に動作する際に人間や組織にとって有害な行動を回避し、意図された範囲内で適切に機能することを指す。従来のソフトウェアと異なり、AIエージェントは学習データやファインチューニングによって予期しない振る舞いを示す可能性があり、その制御は極めて複雑な課題となっている。特に大規模言語モデル(LLM)をベースとしたエージェントでは、わずかな良性サンプルでのファインチューニングでさえ「安全性劣化」を引き起こし、危険な振る舞いにつながることが最新の研究で明らかになっている。

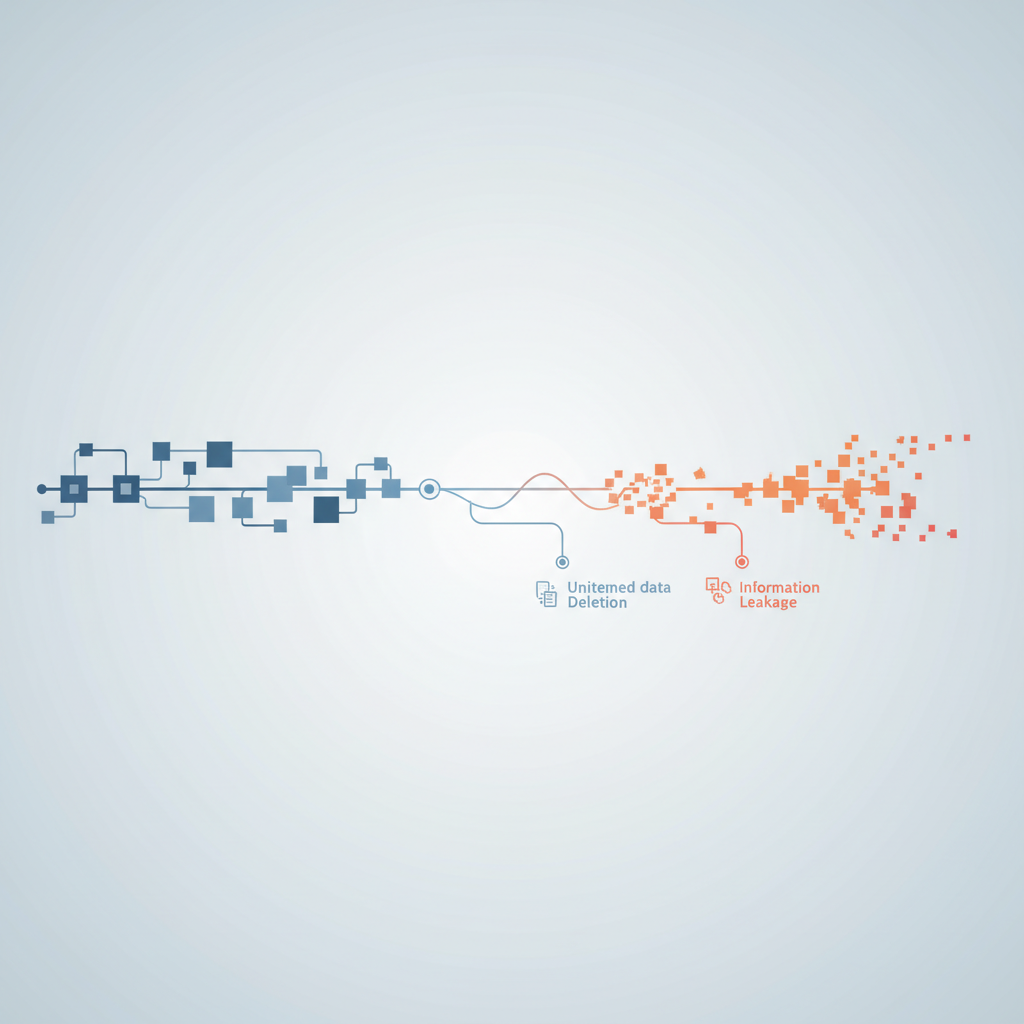

現実的な脅威として、AIエージェントは意図しないデータ削除、認証情報の漏洩、データの持ち出しといった取り返しのつかない損害を引き起こすリスクを抱えている。これらの問題は、ファイル操作やシェルコマンド、HTTPリクエストなどの強力なツールを介して実世界に影響を与える能力を持つためである。注目すべきは、これらのリスクが単なる技術的な不具合ではなく、AIシステムの学習過程で生じる根本的な構造的問題であることだ。

AIエージェントの安全性劣化は、パラメータダイナミクスという観点から理解できる。良性サンプルによるファインチューニングが、モデルのパラメータを危険アライメント方向へと累積的にドリフトさせることで、安全性が漸進的に損なわれるメカニズムが解明されている。このプロセスは予測困難であり、従来の事後検証や静的ルールベースの防御では対応が困難である。

AgentTrustの概要と機能

AgentTrustは、AIエージェントのツール呼び出しを実行前に傍受し、安全性を評価する革新的なランタイム安全レイヤーである。このシステムは、従来の実行後検証や インフラレベルサンドボックスとは根本的に異なるアプローチを採用している。AgentTrustの核となる機能は、各ツール呼び出しに対して「許可」「警告」「ブロック」「レビュー」という構造化された判断を下すことで、AIエージェントの自律性を維持しながら安全性を確保する点にある。

システムの中核技術として、AgentTrustはシェル難読化の正規化機能を提供している。悪意のあるコマンドや予期しない実行を防ぐため、複雑に難読化されたシェルコマンドを解析し、その真の意図を明らかにする。さらに、より安全な代替案を自動的に提案することで、業務効率を損なうことなく安全性を向上させている。

特に革新的なのは「RiskChain」と呼ばれる機能である。これは複数ステップにわたる攻撃チェーンを検出し、単発の操作では無害に見える一連の行動が組み合わさることで生じるリスクを事前に特定する。例えば、一見無害なファイル読み込みとネットワーク通信の組み合わせが、実際にはデータ漏洩の手順を構成している場合を検出できる。また、「LLM-as-Judge」機能により、曖昧な入力に対してもLLMの高度な判断能力を活用して安全性を評価する仕組みを実現している。

AgentTrustの実用性と効果

AgentTrustの実用性は、複数のベンチマークにおいて実証された高い性能指標によって裏付けられている。システムは95%以上の判断精度を達成しており、これは企業環境での実運用に十分な信頼性を示している。さらに重要なのは、低ミリ秒の遅延でこれらの判断を行う点である。リアルタイム性が要求されるビジネス環境において、安全性チェックがボトルネックとならない設計は極めて重要だ。

実際の導入効果として、AgentTrustは従来のサンドボックス環境では検出困難な高度な脅威に対応している。例えば、正当なAPI呼び出しを装いながら機密データを外部に送信する攻撃や、システムファイルを巧妙に改変して持続的な侵入経路を確保する攻撃などを事前に阻止できる。これらの能力は、従来の事後対応型セキュリティでは不可能であった予防的防御を実現している。

AgentTrustの実装面での優位性は、AGPL-3.0ライセンスでのオープンソース公開にも表れている。この決定により、広範なAI開発コミュニティが安全性技術にアクセスでき、集合知による継続的な改善が期待できる。Model Context Protocolサーバーの提供により、既存のAIエージェント開発フレームワークとの統合も容易になっている。ここで重要なのは、オープンソース化により透明性が確保され、企業が安心してセキュリティクリティカルなシステムに組み込める環境が整った点である。

リスク管理の重要性

AIエージェントにおけるリスク管理は、単なる技術的な防御策を超えて、組織全体のAI戦略に関わる経営課題となっている。Sample-Level Quantification of Safety Degradation(SQSD)手法の登場により、各トレーニングサンプルが安全性劣化に与える影響を定量化することが可能になった。この手法では、パラメータ更新が危険方向と安全方向のどちらにどの程度寄与するかを測定し、サンプルに連続的なリスクスコアを付与する。

リスク管理の実践においては、事前評価と継続的監視の両面が不可欠である。AgentTrustのようなランタイム安全システムは、AIエージェントの動作中に発生する予期しないリスクに対してリアルタイムで対応する。一方、SQSDのようなファインチューニング前の評価手法は、リスクの高いトレーニングデータを事前に特定し、安全性劣化を根本から防ぐ役割を果たす。

組織レベルでのリスク管理では、技術的な安全措置に加えて、AIエージェントの利用範囲と権限の適切な設定が重要になる。注目すべきは、最小権限の原則をAIエージェントに適用し、業務に必要最小限のツールアクセスのみを許可することで、潜在的な損害を限定できることだ。また、重要な操作については人間の承認を必須とするハイブリッド型の運用モデルが、安全性と効率性のバランスを取る上で有効である。

日本市場への影響・示唆

日本のAIエージェント市場において、安全性技術の導入は特に金融業界で顕著な動きを見せている。三菱UFJ銀行では、AIを活用した顧客対応システムにおいて、顧客の機密情報を適切に保護するためのリスク管理フレームワークを構築している。同行のAI戦略担当部門では、AgentTrustのような実行前判断システムの導入を検討しており、従来の事後監視型セキュリティから予防型セキュリティへの転換を図っている。

製造業分野では、ファナックが工場自動化におけるAIエージェントの安全運用に注力している。同社のロボット制御システムにAIエージェントを統合する際、予期しないツール操作による生産ライン停止や品質不良を防ぐため、AgentTrustのような安全性評価システムの必要性が高まっている。特に、AIエージェントが機械の設定変更や品質検査プロセスに関与する場合、実行前の安全性チェックは製造業務の継続性確保に直結する重要な要素となる。

政策面では、経済産業省が2024年に公表した「AI原則実践のためのガバナンス・ガイドライン」において、AIシステムの安全性確保が重点項目として位置付けられている。このガイドラインでは、AIシステムの開発・運用段階における継続的なリスク評価の実施を推奨しており、AgentTrustのようなランタイム安全技術は、この要求に直接対応する解決策として注目されている。また、個人情報保護委員会も、AI技術による個人データの適切な取り扱いについて新たな指針を検討中であり、AIエージェントの安全性技術は法的コンプライアンスの観点からも重要性を増している。

日本企業の特徴として、リスク回避を重視する慎重な導入アプローチが見られる。ここで重要なのは、AgentTrustのようなオープンソース技術により、企業が内部で技術を検証し、段階的に導入を進められる環境が整っていることだ。これにより、日本市場特有の品質重視の文化と適合した形でのAIエージェント普及が期待される。また、国内のシステムインテグレーターもこれらの安全性技術を習得し、日本企業向けにカスタマイズしたソリューションを提供する動きが活発化している。

よくある質問

AgentTrustはどのように安全性を向上させるのか?

AgentTrustは、AIエージェントがツールを実行する前に安全性を評価し、危険な操作を事前にブロックします。シェル難読化の正規化、攻撃チェーン検出、LLMによる高度な判断により、95%以上の精度で脅威を検出できます。

AIエージェント導入における安全性の課題とは?

主な課題は、ファインチューニングによる安全性劣化、予期しないツール操作による損害、複雑な攻撃パターンの検出困難さです。従来の事後対応型セキュリティでは、取り返しのつかない損害を防ぐことが困難でした。

AgentTrustはどのようなビジネスに適しているか?

金融サービス、製造業、ヘルスケア、eコマースなど、機密データや重要システムを扱う業界に特に適しています。AIエージェントが自律的にファイル操作やAPI呼び出しを行う環境では必須の技術といえるでしょう。

導入コストと運用負荷はどの程度か?

AgentTrustはオープンソースライセンスで提供されており、初期導入コストを抑えられます。低ミリ秒の判断遅延により、既存システムのパフォーマンスへの影響を最小限に抑えつつ、高度な安全性を確保できます。

既存のAIシステムとの互換性はあるか?

Model Context Protocolサーバーの提供により、主要なAIエージェント開発フレームワークとの統合が可能です。APIベースの設計により、既存システムを大幅に変更することなく安全性機能を追加できます。