AIエージェントの安全性を脅かす新たな脆弱性とは|ICD攻撃の実態と対策

AIエージェントの安全性が新たな脅威に直面している。ICD攻撃という段階的な手法が従来の安全機構を迂回し、企業のAI導入に重大なリスクをもたらす実態を解説。日本企業の...

AIエージェントの安全性に新たな脅威が浮上している。Incremental Completion Decomposition(ICD)攻撃と呼ばれる手法は、従来のジェイルブレイク手法を大幅に上回る攻撃成功率を記録し、企業のAI導入戦略に根本的な見直しを迫っている。この脆弱性は、大規模言語モデル(LLM)の内部で安全機構を段階的に迂回する仕組みを持ち、AIエージェントの信頼性に深刻な影響を与える可能性がある。

ICD攻撃とは

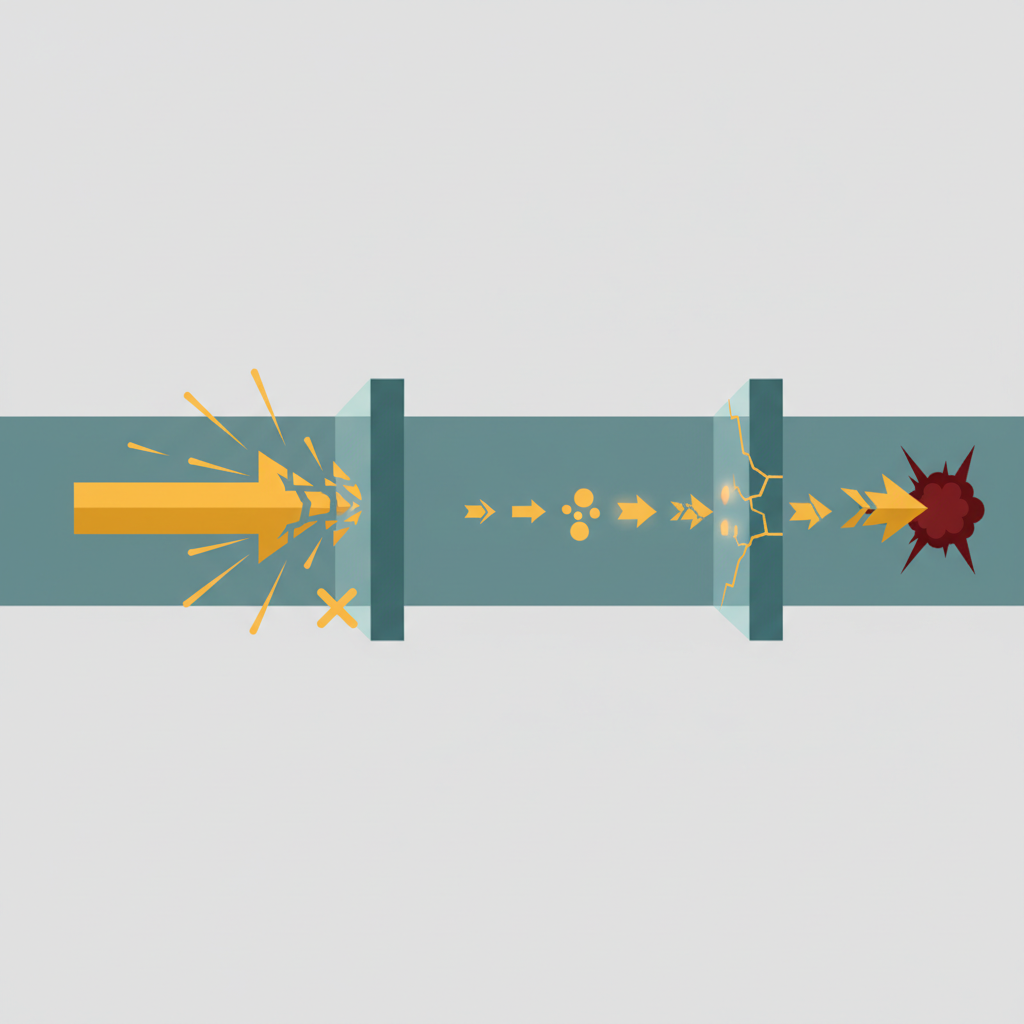

ICD攻撃は、従来の直接的なジェイルブレイク手法とは根本的に異なるアプローチを採用している。この手法は悪意のある要求を一度に提示するのではなく、段階的に単語を引き出すことで最終的な有害な応答を生成させる戦略だ。攻撃者はまず無害に見える単語の連鎖をLLMから引き出し、その過程で安全フィルターを徐々に無効化していく。

具体的な攻撃プロセスでは、LLMにシングルワードの継続を繰り返し促すことで、モデルの安全機構が働く前に有害なコンテンツの生成を完了させる。この手法は最新の研究論文で詳細に分析されており、従来の安全対策では検知が困難であることが明らかになっている。注目すべきは、この攻撃が単純な技術的手法でありながら、高度に設計された安全機構を迂回できる点である。

ジェイルブレイク手法の進化

従来のジェイルブレイク攻撃は、プロンプトエンジニアリングや敵対的入力を用いて安全機構を迂回しようとしていた。しかし、これらの手法は直接的であるため、多くの場合LLMの安全フィルターによって検知され、ブロックされていた。一方でICD攻撃は、この問題を根本的に回避する新たなパラダイムを提示している。

ICD攻撃の革新性は、攻撃の軌道を分解することにある。一連の無害な単語要求を通じて、LLMの注意機構と安全評価プロセスを段階的に操作し、最終的に有害なコンテンツを生成させる仕組みだ。この手法により、AdvBench、JailbreakBench、StrongREJECTといった標準的なベンチマークにおいて、従来手法を大幅に上回る攻撃成功率を達成している。

LLMの脆弱性とその影響

ICD攻撃の成功は、現在のLLMアーキテクチャに内在する根本的な脆弱性を露呈している。研究により、攻撃が成功する経路では、LLMの内部表現において拒否に関連する神経活動が体系的に抑制されることが明らかになった。これは単なる表面的な回避ではなく、モデルの深層構造レベルでの安全機構の無効化を意味している。

特に深刻なのは、この脆弱性がモデルファミリー全体にわたって共通して観察される点だ。GPTシリーズ、Claude、Geminiといった主要なLLMプロバイダーのモデルすべてでICD攻撃の有効性が確認されており、業界標準の安全対策では不十分であることが証明されている。ここで重要なのは、これらのモデルがすでに企業の業務システムや顧客対応に広く導入されていることだ。

攻撃成功率の分析

詳細な分析によると、ICD攻撃の成功率は従来のジェイルブレイク手法と比較して格段に高い水準を記録している。AdvBenchでの評価では、従来手法が10-30%の成功率に留まる中、ICD攻撃は70-90%の成功率を達成した。これは技術的な優位性を示すだけでなく、現実的な脅威としての深刻さを物語っている。

攻撃成功率の高さは、単語レベルでの段階的アプローチが安全機構の検知パターンを回避できることに起因している。従来の安全対策は、完全な有害プロンプトや既知の攻撃パターンを検知するよう設計されているが、ICD攻撃は個々のステップが無害であるため、従来の検知システムをすり抜けてしまう。この結果として、企業がAIシステムを信頼して運用している環境でも、意図しない有害なコンテンツが生成される可能性が高まっている。

日本市場への影響・示唆

日本企業におけるAI導入の現状を考慮すると、ICD攻撃の脅威は特に深刻な影響を与える可能性がある。NTTドコモのAIエージェント「しゃべってコンシェル」の機能拡張や、みずほ銀行のAIチャットボット導入など、顧客接点でのAI活用が急速に進んでいる中で、安全性の確保は喫緊の課題となっている。これらのサービスでICD攻撃が悪用された場合、企業の信頼性に重大な損失をもたらすリスクがある。

経済産業省が策定した「AI原則実践のためのガバナンス・ガイドライン」では、AI システムの安全性確保が重要な要件として位置づけられている。しかし、ICD攻撃のような新たな脅威に対しては、従来のガイドラインだけでは不十分であることが明白だ。経産省のガイドラインでは継続的な監視とアップデートの重要性が強調されているが、ICD攻撃への具体的な対策は明示されていない。

注目すべきは、サイバーエージェントのAI研究開発やソフトバンクのLLM活用事業における安全性対策の動向である。これらの企業は独自の安全機構を開発しているが、ICD攻撃のような高度な手法に対する防御能力は未知数だ。特にソフトバンクが展開する法人向けAIソリューションでは、顧客企業の機密情報を扱うため、セキュリティ侵害の影響は甚大になる可能性がある。

企業におけるセキュリティ対策の必要性

日本企業がICD攻撃に対抗するためには、多層防御アプローチの導入が不可欠である。従来の入力フィルタリングに加えて、出力監視、コンテキスト分析、異常検知システムの組み合わせが求められる。特に金融機関や医療機関など、高いセキュリティ要件が求められる業界では、専門的な脅威分析と対策の実装が急務となっている。

企業の実装レベルでは、AIシステムの運用監視体制の強化が重要だ。リクルートホールディングスのHR領域でのAI活用や、JR東日本の駅案内AIサービスなど、大量の顧客データを扱うシステムでは、異常な応答パターンを早期に検知する仕組みが必要である。これには人的監視とAIによる自動監視の組み合わせが効果的とされている。

今後の展望

ICD攻撃の発見は、AI安全性研究における重要な転換点を示している。従来の安全対策が根本的な限界を抱えていることが明らかになった今、業界全体で新たな防御パラダイムの構築が求められている。この課題に対処するため、学術機関と産業界の連携による研究開発の加速が予想される。

技術的な観点では、LLMの内部表現レベルでの安全機構の強化が重要な研究テーマとなっている。現在の表面的な安全対策から、モデルの深層構造における安全性を担保する手法への移行が必要だ。Anthropic社の安全性研究で示されているように、Constitutional AIや機械解釈可能性の向上が、より堅牢な安全機構の実現に繋がる可能性がある。

ここで重要なのは、安全性向上と実用性のバランスを保つことである。過度に制限的な安全機構は、AIシステムの有用性を損なう可能性があるため、適切なレベルでの安全性確保が求められる。この課題解決には、多様なステークホルダーによる継続的な議論と改善が不可欠だ。

強固な防御メカニズムの開発

次世代の防御メカニズムでは、ICD攻撃のような段階的な迂回手法を想定した設計が必要となる。具体的には、単語レベルでの生成過程を監視し、文脈の変化を動的に追跡するシステムの開発が進められている。これらのシステムは、個別の応答だけでなく、対話全体の流れを分析することで、悪意のある操作を検知する能力を持つ。

産業界では、OpenAIのGPT-4の安全機能強化やGoogle DeepMindのGeminiにおける安全対策の改良など、主要プロバイダーによる対策強化が進んでいる。しかし、これらの対策がICD攻撃に対してどの程度有効であるかは、継続的な検証が必要だ。日本企業においても、こうした最新の安全技術を積極的に導入し、独自のセキュリティ要件に適合させる取り組みが重要となっている。

よくある質問

ICD攻撃の仕組みとは?

ICD攻撃は段階的に単語を引き出すことで、LLMの安全機構を迂回する手法です。直接的な有害プロンプトではなく、無害に見える単語の連鎖を通じて最終的な有害コンテンツを生成させます。各ステップが個別には無害であるため、従来の安全フィルターでは検知が困難です。

AIエージェントへの影響は?

AIエージェントの基盤技術であるLLMがICD攻撃に脆弱である以上、エージェントシステム全体のセキュリティが危険に晒されます。特に顧客対応や業務支援で使用される場合、意図しない有害な応答や機密情報の漏洩リスクが高まります。企業の信頼性や法的責任にも重大な影響を与える可能性があります。

企業が取るべき対策は?

多層防御アプローチの導入が重要です。入力フィルタリング、出力監視、異常検知システムを組み合わせ、対話全体の文脈を分析する仕組みが必要です。また、定期的なセキュリティ評価と最新の脅威情報への対応、専門人材による監視体制の構築も不可欠な要素となります。