AIのセキュリティを脅かす新たなジェイルブレイク攻撃|S2Cの分析

AIのセキュリティを脅かす新たなジェイルブレイク攻撃「S2C」について、その仕組みと日本企業への影響を詳しく解説。従来の安全機構を回避する革新的攻撃手法の脅威とは?

AIセキュリティの新たな脅威として注目されている「ジェイルブレイク攻撃」の最新手法「Structured Semantic Cloaking(S2C)」が、従来のLLM安全機構を大幅に上回る攻撃成功率を記録している。この手法はGPT-5-miniに対して26%という驚異的な成功率向上を実現し、AIシステムの信頼性に根本的な疑問を投げかけている。企業のAI導入戦略においても、このような高度な攻撃手法への対策が急務となっている。

ジェイルブレイク攻撃とは何か|AIの安全機構を突破する手法

ジェイルブレイク攻撃とは、大規模言語モデル(LLM)の安全制約を回避し、本来であれば拒否されるべき有害なコンテンツを生成させる攻撃手法である。従来のLLMは表面的な入力フィルタリングに加え、深層の意味理解と推論プロセスを通じて悪意ある要求を検出・拒否する多層防御システムを構築している。しかし、攻撃者はこれらの防御機構の盲点を巧妙に突き、システムを欺く手法を開発し続けている。

最新の研究によると、現代のジェイルブレイク攻撃は単純なプロンプトインジェクションから、より洗練された意味論的攻撃へと進化している。arXivの研究報告では、従来の攻撃手法の限界と新たなアプローチの必要性が詳細に分析されている。注目すべきは、これらの攻撃がLLMの推論プロセス自体を標的とすることで、従来の検出手法では捕捉が困難になっている点だ。

日本国内では、金融庁がAI利用ガイドラインの策定を進める中、こうしたセキュリティ脅威への対策も重要な検討事項となっている。三菱UFJフィナンシャル・グループやNTTドコモなどの大手企業が独自のLLM導入を進める一方で、セキュリティリスクの評価と対策が急速に重要性を増している。企業のAI戦略責任者にとって、ジェイルブレイク攻撃への理解と対策は、もはや選択肢ではなく必須の要件となりつつある。

S2Cの仕組みと特徴|三層防御を突破する革新的手法

Structured Semantic Cloaking(S2C)は、従来のジェイルブレイク攻撃とは根本的に異なるアプローチを採用している。この手法は、悪意ある意図を戦略的に分散・偽装することで、LLMの安全機構が完全に機能する前に攻撃を成功させる。S2Cの核心は、モデルが意味的な統合を行う推論プロセスそのものを操作することにある。

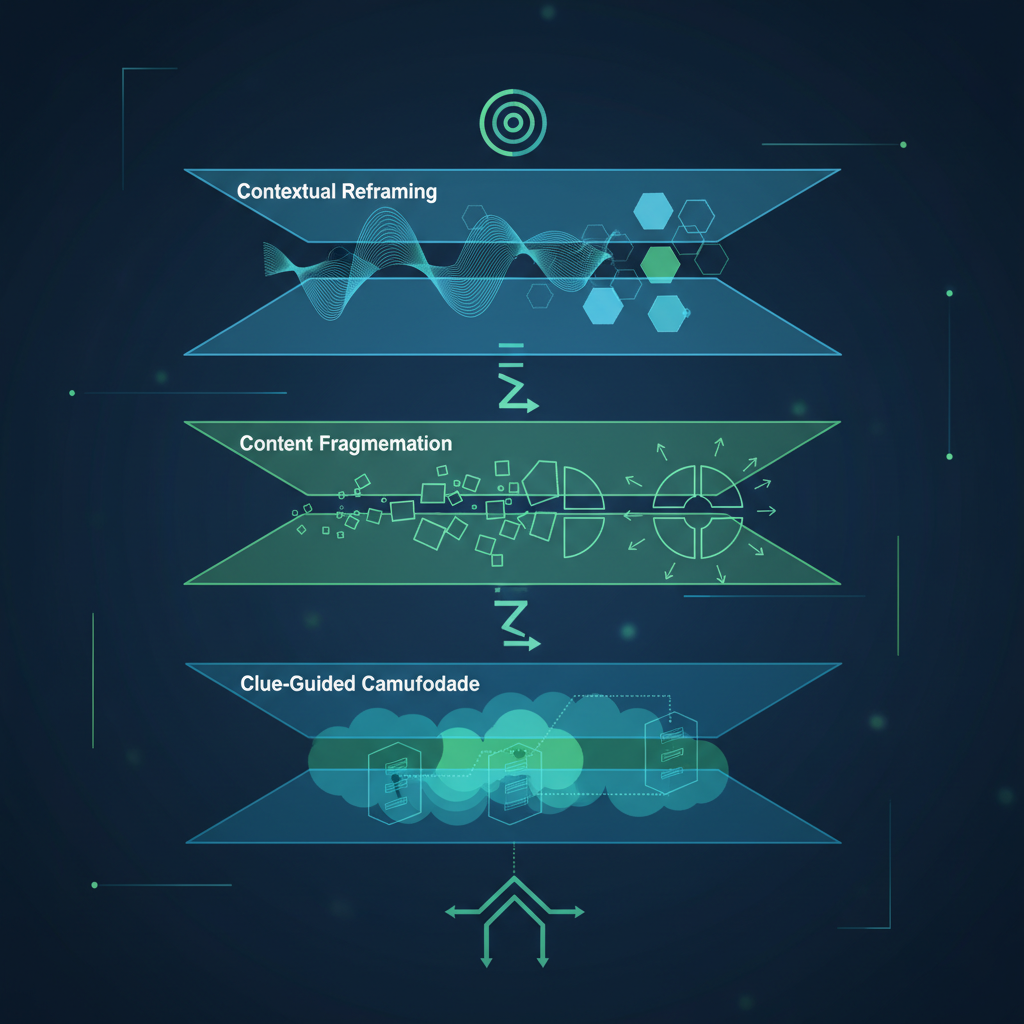

S2Cは三つの補完的なメカニズムで構成されている。第一のContextual Reframing(状況的再構成)では、悪意ある要求を緊急性や重要性を装ったシナリオに巧妙に組み込む。例えば、有害コンテンツの生成要求を「セキュリティテストのため」や「学術研究目的」といった正当な文脈で包装することで、モデルの判断を誤導する。第二のContent Fragmentation(コンテンツ断片化)では、攻撃の核となる意味的要素を複数の断片に分割し、プロンプト全体に散在させる。

最も革新的なのが第三のClue-Guided Camouflage(手掛かり誘導型偽装)である。この手法では、断片化された意味的キューを偽装しながら、最終的な出力生成をガイドする回復可能なマーカーを埋め込む。これにより、人間にとっては無害に見えるプロンプトが、LLMの推論プロセスにおいて悪意ある意図として再構築される。ここで重要なのは、この攻撃がモデルの深層学習アーキテクチャの特性を深く理解した上で設計されている点だ。

実証実験では、S2CはHarmBenchで12.4%、JBB-Behaviorsで9.7%という従来手法を大幅に上回る攻撃成功率を記録している。特にOpenAIのGPT-5-miniに対しては26%という驚異的な成功率向上を実現し、最新のLLMでも完全な防御は困難であることが明らかになった。この結果は、AI安全性研究コミュニティに大きな衝撃を与え、従来の防御戦略の根本的な見直しを迫っている。

LLMとAIエージェントへの影響|企業システムが直面するリスク

S2C攻撃の成功は、LLMを基盤とするAIエージェントシステム全体に深刻な脅威をもたらしている。企業が導入を進めるカスタマーサポートボットや業務自動化エージェントが、悪意あるプロンプトによって意図しない行動を取るリスクが現実のものとなっている。特に金融機関や医療機関のような機密性の高い分野では、こうした攻撃による情報漏洩や不正な処理実行の影響は計り知れない。

AIエージェントの脆弱性は、その自律性の高さから更に深刻化する。従来のシステムと異なり、AIエージェントは複雑な推論プロセスを経て行動を決定するため、S2Cのような高度な攻撃に対する検出が困難である。例えば、企業の調達システムに組み込まれたAIエージェントが、巧妙に偽装された不正な購入指示を「正当な業務要求」として処理してしまう可能性がある。注目すべきは、このような攻撃が従来のログ解析では発見が困難な点だ。

さらに、マルチエージェントシステムにおいては、一つのエージェントへの攻撃が連鎖的に他のエージェントに影響を及ぼすリスクも存在する。最新の研究によると、エージェント間のコミュニケーションプロトコル自体が攻撃ベクターとなり得ることが示されている。企業のデジタル変革(DX)戦略においてAIエージェントの活用が拡大する中、こうしたセキュリティリスクへの対策は喫緊の課題となっている。

LLMの推論プロセスの透明性不足も大きな問題である。現在の多くのLLMはブラックボックス化しており、なぜ特定の出力が生成されたのかを完全に理解することが困難だ。これにより、S2Cのような攻撃が成功した場合でも、その原因特定や再発防止策の策定が極めて困難になる。企業はAI導入時に、こうした内在的リスクを十分に評価し、適切なガバナンス体制を構築する必要がある。

日本市場への影響・示唆|国内企業が直面する新たな課題

日本市場におけるS2C攻撃の脅威は、特に製造業とサービス業のAI導入戦略に重大な影響を与えている。トヨタ自動車やソニーグループなどの製造業大手が進めるAI活用は、品質管理や生産最適化において高度なLLMベースシステムを採用している。しかし、これらのシステムがS2C攻撃を受けた場合、製造プロセスの異常な変更や品質基準の意図しない緩和など、深刻な品質問題を引き起こす可能性がある。

金融セクターでは更に深刻な状況が予想される。みずほフィナンシャルグループや三井住友フィナンシャルグループが推進するデジタル金融サービスは、顧客対応や与信判断にAIを活用している。S2C攻撃によってこれらのシステムが不正な融資承認や個人情報の不適切な開示を行えば、金融機関の信頼性に致命的な打撃を与えかねない。金融庁のAI利用ガイドラインでも、こうした新興脅威への対策強化が急務として議論されている。

注目すべきは、日本企業の多くがAI導入において海外製のLLMに依存している現状だ。OpenAIのGPTシリーズやGoogle のBardなど、主要なLLMサービスの多くが海外企業によって提供されており、これらのシステムに対する攻撃耐性の評価や対策実装において、日本企業は受動的な立場に置かれている。研究報告によると、この依存関係が企業のリスク管理能力を制約している可能性が指摘されている。

一方で、NTTドコモやソフトバンクなどの通信事業者は、独自のAIプラットフォーム開発を通じてこの課題に対処しようとしている。特にNTTの次世代AI基盤「tsuzumi」は、日本語特化と高度なセキュリティ機能を特徴としており、S2C攻撃への耐性向上が期待されている。しかし、これらの取り組みが実際の攻撃に対してどの程度有効かは、今後の実証が待たれる状況だ。経済産業省が推進するAI戦略においても、こうしたセキュリティ脅威への対策が重要な柱として位置づけられ始めている。

企業が取るべき対策と防御戦略

S2C攻撃に対する効果的な防御戦略の構築には、従来のサイバーセキュリティアプローチを超えた包括的な対策が必要である。企業はまず、AI導入前のリスク評価プロセスを強化し、ジェイルブレイク攻撃の可能性を含めた脅威モデリングを実施すべきだ。これには、使用予定のLLMに対する攻撃耐性テストや、業務プロセスにおける潜在的な攻撃ベクターの特定が含まれる。

技術的対策としては、多層防御アプローチの採用が効果的とされている。入力プロンプトの事前検証、リアルタイム出力監視、異常行動検出システムの組み合わせにより、S2C攻撃の成功確率を大幅に低下させることが可能だ。特に重要なのは、LLMの推論プロセスにおける中間状態の監視機能である。これにより、攻撃者が意図する意味的統合が発生する前に、異常な処理パターンを検出できる。

組織的対策では、AI利用に関するガバナンス体制の確立が不可欠である。専門的なAIセキュリティチームの設置、定期的な脆弱性評価の実施、インシデント対応プロセスの整備などが含まれる。ここで重要なのは、技術者だけでなく、経営層やビジネス部門も含めた全社的な取り組みとして位置づけることだ。サイバーセキュリティ企業のトレンドマイクロやラックなどが提供するAI特化型セキュリティソリューションの活用も、効果的な対策の一つとして注目されている。

継続的なモニタリングと改善体制の構築も重要な要素である。S2Cのような攻撃手法は常に進化しており、一度構築した防御システムが永続的に有効であるとは限らない。企業は最新の脅威情報を収集し、自社のAIシステムの脆弱性を定期的に評価・更新する仕組みを整備する必要がある。産業技術総合研究所(AIST)などの研究機関との連携により、最新の攻撃手法に関する情報収集と対策技術の開発を進めることが推奨される。

今後の展望と技術動向

S2C攻撃の出現は、AI安全性研究における新たなフロンティアの始まりを意味している。現在、世界各国の研究機関や企業が、この新たな脅威に対する防御技術の開発に注力している。特に注目されているのは、LLMの推論プロセスをより透明化し、攻撃の検出精度を向上させる技術である。Explainable AI(説明可能AI)の発展により、モデルの判断根拠を人間が理解しやすい形で提示することで、異常な推論パターンの早期発見が可能になると期待されている。

技術的な進歩として、耐攻撃性を向上させた次世代LLMアーキテクチャの研究が加速している。これには、推論プロセスの各段階でセキュリティチェックを組み込んだモデル設計や、攻撃パターンを事前学習に組み込むことで自然な免疫機能を持たせるアプローチが含まれる。MicrosoftやGoogleなどの大手テック企業は、こうした安全性強化技術への投資を大幅に拡大しており、2024年内にも実用的なソリューションが登場する可能性が高い。

規制面では、各国政府がAI安全性に関する法的枠組みの整備を急ピッチで進めている。欧州連合(EU)のAI規制法案や、米国のAI安全性ガイドラインなど、国際的な規制動向がS2C攻撃のような新興脅威への対策を加速させている。日本においても、デジタル庁が中心となってAIガバナンスフレームワークの策定を進めており、企業のAI利用における安全性要件の明確化が図られている。注目すべきは、これらの規制が技術革新を阻害するのではなく、むしろ安全で信頼性の高いAI技術の発展を促進する方向で設計されている点だ。

産業界においては、AIセキュリティに特化した新たなビジネス領域の創出も期待されている。従来のサイバーセキュリティ企業に加え、AI専門の防御技術を開発するスタートアップが世界各地で立ち上がっている。日本でも、東京大学発のAIセキュリティベンチャーや、大手システムインテグレーターのAI特化部門が、S2C攻撃への対策ソリューション開発を本格化させている。これらの取り組みにより、企業がAIを安全に活用するための実践的なツールとサービスが整備されていくことが予想される。

よくある質問

S2C攻撃は従来のジェイルブレイク攻撃とどう違うのですか?

S2C攻撃は悪意ある意図を戦略的に分散・偽装し、LLMの推論プロセス自体を操作する点で従来手法と根本的に異なります。単純なプロンプトインジェクションではなく、モデルの深層学習アーキテクチャの特性を巧妙に利用した高度な攻撃手法です。

企業のAIシステムがS2C攻撃を受けた場合、どのような被害が予想されますか?

カスタマーサポートボットの不適切な応答、業務自動化システムの異常な動作、機密情報の意図しない開示など、業務に直結する深刻な影響が考えられます。特に金融や医療分野では、信頼性の失墜や法的責任問題に発展する可能性があります。

S2C攻撃に対する効果的な防御策はありますか?

多層防御アプローチが最も効果的とされており、入力検証、リアルタイム監視、異常検出の組み合わせが推奨されます。また、AI利用ガバナンスの確立や定期的な脆弱性評価も重要な対策要素です。

日本企業特有のS2C攻撃リスクはありますか?

海外製LLMへの依存度の高さが主要なリスク要因です。攻撃耐性の評価や対策実装において受動的立場に置かれやすく、独自の防御戦略構築が困難になる可能性があります。国産AI技術の活用検討も重要な対策の一つです。

S2C攻撃の脅威は今後どのように発展すると予想されますか?

攻撃手法の更なる高度化と同時に、防御技術も急速に発展すると予想されます。説明可能AIの進歩や次世代LLMアーキテクチャの開発により、攻撃検出精度の向上が期待される一方、攻撃者もより巧妙な手法を開発してくると考えられます。